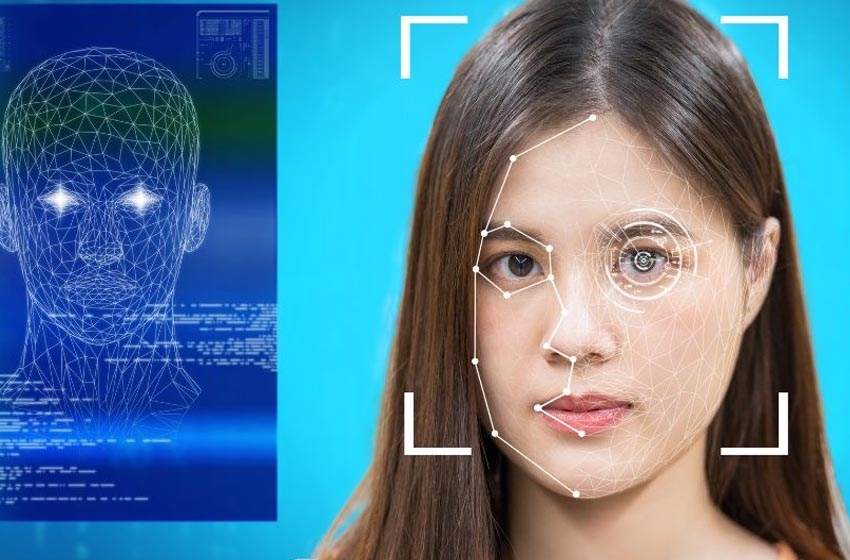

വ്യാജവാര്ത്തകളോടു പടവെട്ടിക്കൊണ്ടിരിക്കുകയാണ് ഇന്നത്തെ ലോകം. ഈ പ്രശ്നങ്ങള്ക്ക് ആക്കംകൂട്ടുകയാണ് എഐ അധിഷ്ഠിതമായ ഡീപ്ഫേക്ക് ഉള്ളടക്കങ്ങള്. ഡീപ്ഫേക്ക് തെറ്റായ വിവരങ്ങളുടെ ഏറ്റവും പുതിയതും അപകടകരവുമായ രൂപമാണ്. ആര്ട്ടിഫിഷ്യല് ഇന്റലിജന്സിന്റെ പിന്തുണയില് കൃത്രിമമായി നിര്മിക്കപ്പെട്ട യഥാര്ഥമെന്നു തോന്നുന്ന ചിത്രങ്ങള്, വീഡിയോകള്, ശബ്ദം ഉള്പ്പടെയുള്ള ഉള്ളടക്കങ്ങളെയാണ് ഡീപ് ഫേക്കുകള് എന്നു വിളിക്കുന്നത്. എഐയെ പ്രതിനിധീകരിക്കുന്ന ഡീപ്പ് ലേണിങ് എന്ന വാക്കും വ്യാജം എന്നര്ഥം വരുന്ന ഫേക്ക് (Fake) എന്ന വാക്കും സംയോജിപ്പിച്ചതാണ് ഡീപ്ഫേക്ക് എന്ന പേര്.

ഡീപ്ഫേക്ക് സാങ്കേതികവിദ്യ അതിശയിപ്പിക്കുന്നതാണെങ്കിലും, അങ്ങേയറ്റം അപകടകരവുമാണ്. ഉദാഹരണത്തിന്, ഒരു തിരഞ്ഞെടുപ്പിനു ദിവസങ്ങള്ക്കുമുമ്പ്, വിദ്വേഷപ്രസംഗങ്ങളും വംശീയ അധിക്ഷേപങ്ങളും വിശേഷണങ്ങളും ഉപയോഗിച്ച് ഒരു സ്ഥാനാര്ഥിയുടെ ഡീപ്ഫേക്ക് വീഡിയോ പുറത്തുവരുന്നതു സങ്കല്പിക്കുക. അതയാളുടെ പ്രതിച്ഛായയെ തകര്ക്കുന്നു. രാഷ്ട്രീയജീവിതം പൊലിയുന്നു. ഡീപ് ഫേക്കുകള് നമുക്കു ചുറ്റും വ്യാജ ഉള്ളടക്കങ്ങളുടെ മായാലോകം തീര്ക്കുന്ന കാലമാണിത്.

ഡീപ്ഫേക്കിന്റെ പ്രയോജനവും ഉപയോഗവും

ഒരു വ്യക്തിയുടെ മുഖത്തെ പേശീചലനങ്ങള്വരെ വിശകലനം ചെയ്താണ് എഐ ഡീപ്ഫേക്ക് വീഡിയോകള് തയ്യാറാക്കുക. ശബ്ദവും മുഖഭാവവും ചുണ്ടിന്റെയും കണ്ണിന്റെയും ചലനവുമൊക്കെ കൃത്യമായിരിക്കും. നമ്മള് പറയാത്ത കാര്യങ്ങള് യഥാര്ഥത്തില് നമ്മള് പറയുന്നതുപോലെയും പാടാത്തതു പാടിയതുപോലെയുമുള്ള വീഡിയോകള് ഇതിലൂടെ നിര്മിക്കാം. അക്കാദമികരംഗത്തും ഗവേഷണരംഗത്തും സിനിമാനിര്മാണത്തിനായുള്ള വിഷ്വല് ഇഫക്ട് സ്റ്റുഡിയോകളിലുമെല്ലാം ഡീപ് ഫേക്ക് സംവിധാനങ്ങള് പ്രയോജനപ്പെടുത്താനാവും. നടീനടന്മാരുടെ വിവിധ പ്രായത്തിലുള്ള കഥാപാത്രങ്ങളെ സൃഷ്ടിച്ചെടുക്കാനും ഡ്യൂപ്പുകള്ക്കു നടന്മാരുടെ മുഖം നല്കാനും ഇത് ഉപയോഗിക്കുന്നുണ്ട്. വിദേശഭാഷകളില്നിന്നുള്ള സിനിമകള് ഡബ്ബ് ചെയ്തെടുക്കുമ്പോള് ചുണ്ടുകളുടെ ചലനം ഭാഷയ്ക്കനുസരിച്ചു മാറ്റാന് ഡീപ്ഫേക്ക് സാങ്കേതികവിദ്യകള് പ്രയോജനപ്പെടുത്തുന്നുണ്ട്.

കൂടുതല് കൃത്യതയോടെ കേള്ക്കാനും കാണാനും കഴിയുന്ന ഉപകരണങ്ങള് സൃഷ്ടിക്കാന് കഴിയും. വിദ്യാഭ്യാസതലത്തില് ആകര്ഷകമായ പാഠങ്ങള് നല്കുന്നതില് ഡീപ്ഫേക്കുകള്ക്ക് അധ്യാപകനെ സഹായിക്കാനാകും. കൂടാതെ, ഈ പാഠങ്ങള് പരമ്പരാഗതദൃശ്യ-മാധ്യമ രൂപകല്പനകള്ക്കപ്പുറത്തേക്കു പോകും. വിലകൂടിയ വിഎഫ്എക്സ് സാങ്കേതികവിദ്യയെ ജനാധിപത്യവത്കരിക്കാനുള്ള കഴിവ് ഡീപ്ഫേക്കിനുണ്ട്. ചെലവുചുരുക്കാന് സിനിമാനിര്മാതാക്കള്ക്ക് ഇത് ഒരു ശക്തമായ ഉപകരണമായി മാറും.

മനുഷ്യാവകാശപ്രവര്ത്തകര്ക്കും പത്രപ്രവര്ത്തകര്ക്കും സിന്തറ്റിക് മീഡിയ ഉപയോഗിച്ച് സ്വേച്ഛാധിപത്യഭരണകൂടങ്ങളില് അജ്ഞാതരായി തുടരാം. ഡിജിറ്റല് ലോകത്ത് സ്വയം പ്രകടിപ്പിക്കുന്നതിനും സംയോജിപ്പിക്കുന്നതിനുമുള്ള പുതിയ ഉപകരണങ്ങള് വ്യക്തികള്ക്കു നല്കാന് ഡീപ്ഫേക്കുകള്ക്കു കഴിയും.

ഡീപ്ഫേക്ക് സാങ്കേതികവിദ്യയുടെ അപകടകരമായ പ്രയോഗങ്ങള്

ഡീപ്ഫേക്കുകളെ അടിസ്ഥാനമാക്കിയുള്ളതാണ് ഇപ്പോള് ഏറ്റവും സാധാരണമായ ആക്രമണരീതികള്. വ്യാജഫോണ്കോളിലൂടെ ശബ്ദം അനുകരിച്ചു ബാങ്കുകളിലും ധനകാര്യസ്ഥാപനങ്ങളിലും തട്ടിപ്പുകള് വ്യാപകമാകുന്നു. ഡീപ്ഫേക്ക് ഉപയോഗിച്ച് കൃത്രിമം കാണിച്ച്, മുഖങ്ങളും ശബ്ദങ്ങളും അനുകരിക്കുന്നു.

ഒരു വ്യക്തിയുടെ ഏതാനും ചിത്രങ്ങള് കൈയിലുണ്ടെങ്കില് അവരെവച്ചു നിങ്ങള്ക്കാവശ്യമുള്ള എന്തു വീഡിയോയും തയ്യാറാക്കാമെന്ന സ്ഥിതി വന്നാലുള്ള അപകടം ഒന്നാലോചിച്ചുനോക്കൂ. തിരഞ്ഞെടുപ്പുകാലത്തോ കലാപകാലത്തോ ഇത്തരം വീഡിയോകളുടെ അപകടസാധ്യത എത്രമാത്രമായിരിക്കും? പ്രത്യേകിച്ച് അത് സ്ത്രീകളെ കൂടുതല് ദ്രോഹിക്കുന്നു. അടുത്തകാലത്ത് ഇന്ത്യന് പ്രധാനമന്ത്രി നരേന്ദ്ര മോദി ഡീപ് ഫേക്കുകള്ക്കെതിരേ ജാഗ്രത പാലിക്കാന് ജനങ്ങളെ ആഹ്വാനം ചെയ്തിരുന്നു.

പൊതുതിരഞ്ഞെടുപ്പുകളില് കൃത്രിമം വരുത്തുക, ഭരണകൂടസ്ഥാപനങ്ങളില് വിശ്വാസം നഷ്ടപ്പെടുത്തുക, മാധ്യമങ്ങളെ ദുര്ബലപ്പെടുത്തുക, സമൂഹികവിഭാഗങ്ങളുടെ ഐക്യം തകര്ത്ത് അവരെ വിഭജിക്കുക, പൊതുസുരക്ഷയെ തരംതാഴ്ത്തുക, പ്രമുഖ രാഷ്ട്രീയ-മതവ്യക്തിത്വങ്ങളുടെയും സര്ക്കാര് ഉദ്യോഗസ്ഥരുടെയും സ്ഥാനാര്ഥികളുടെയുമെല്ലാം സല്പ്പേരിനു കളങ്കം വരുത്തുക തുടങ്ങി ഒരു രാജ്യത്തിന്റെ ജനാധിപത്യസംവിധാനത്തെയും സാമൂഹികക്രമത്തെയും അടിമുടി തകര്ത്തുകളയാന് ഡീപ്ഫേക്കുകള്ക്കു സാധിക്കുമെന്നതു രാജ്യത്തിനു തന്നെ ഭീഷണിയാണ്.

ഡീപ്ഫേക്കുകളുടെ നൈതികതയെന്താണ്?

ഡീപ്ഫേക്കുകള് ഉപയോഗിച്ചു തെറ്റായ ആഖ്യാനം സൃഷ്ടിക്കുന്നത് അപകടകരമാണ്. മാത്രമല്ല, വ്യക്തികള്ക്കും സമൂഹത്തിനും മൊത്തത്തില് മനഃപൂര്വവും അല്ലാത്തതുമായ ദോഷം വരുത്തുകയും ചെയ്യും.

ഡീപ്ഫേക്കുകള് ലോകം അഭിമുഖീകരിക്കുന്ന ആഗോളപ്രതിസന്ധികളെ കൂടുതല് വഷളാക്കും. കാരണം, അവ വെറും വ്യാജമല്ല, മറിച്ച്, വളരെ യാഥാര്ഥ്യബോധമുള്ളതിനാല് അവ കാഴ്ചയുടെയും ശബ്ദത്തിന്റെയും നമ്മുടെ ഏറ്റവും സഹജമായ ഇന്ദ്രിയങ്ങളെ കബളിപ്പിക്കുന്നു. മറ്റൊരാളുടെ ശബ്ദം ഉപയോഗിച്ചും, മറ്റൊരാളുമായി മുഖം മാറ്റിയും, കൃത്രിമചിത്രങ്ങള് നിര്മിച്ചുനടത്തുന്ന പ്രവര്ത്തനങ്ങള് അധാര്മികമാണ്. വ്യക്തികള്ക്കും സ്ഥാപനങ്ങള്ക്കും സൃഷ്ടിക്കാന് സാധ്യതയുള്ള ദോഷങ്ങള് നിരവധിയാണ്.

ഒരു വ്യക്തിയെ ഭയപ്പെടുത്തുന്നതിനോ അപമാനിക്കുന്നതിനോ ബ്ലാക്ക്മെയില് ചെയ്യുന്നതിനോവേണ്ടി സൃഷ്ടിക്കപ്പെട്ട ഡീപ്ഫേക്കുകള് അസന്ദിഗ്ധമായും അധാര്മികമാണ്, ജനാധിപത്യപ്രക്രിയയില് അവ ചെലുത്തുന്ന സ്വാധീനം സമൂഹം വിശകലനം ചെയ്യണം. ഡീപ്ഫേക്ക് സാങ്കേതികവിദ്യയ്ക്കു പൂര്ണമായും കൃത്രിമമായ മുഖമോ വ്യക്തിയോ വസ്തുവോ സൃഷ്ടിക്കാന് കഴിയും. വഞ്ചന, ചാരപ്രവര്ത്തനം നുഴഞ്ഞുകയറ്റം തുടങ്ങിയ ആവശ്യങ്ങള്ക്കായി വ്യാജഡിജിറ്റല് ഐഡന്റിറ്റികള് സൃഷ്ടിക്കുന്നതും അധാര്മികമാണ്.

ഡീപ്ഫേക്കുകളുടെ സ്രഷ്ടാക്കളും വിതരണക്കാരും സിന്തറ്റിക് മീഡിയയെ ധാര്മികമായി ഉപയോഗിക്കുകയും നടപ്പാക്കുകയും ചെയ്യുന്നുവെന്ന് ഉറപ്പാക്കണം. മൈക്രോസോഫ്റ്റ്, ഗൂഗിള്, ആമസോണ് തുടങ്ങിയ വലിയ സാങ്കേതിക പ്ലാറ്റ്ഫോമുകള്, വേഗത്തിലും സ്കെയിലിലും ഡീപ്ഫേക്കുകള് സൃഷ്ടിക്കാന് ടൂളിങ്ങും ക്ലൗഡ് കമ്പ്യൂട്ടിങ്ങും നല്കുന്നു. ഈ കമ്പനികള്ക്കു സമൂഹത്തോടു ധാര്മികമായ ബാധ്യതയുണ്ട്.

ഫേസ്ബുക്ക്, ട്വിറ്റര്, ലിങ്ക്ഡ്ഇന്, ടിക് ടോക് തുടങ്ങിയ സോഷ്യല് മീഡിയ പ്ലാറ്റ്ഫോമുകള്, ഡീപ്ഫേക്കുകളുടെ ഉപയോഗത്തില് ധാര്മികവും സാമൂഹികവുമായ ഉത്തരവാദിത്വം കാണിക്കണം. അതുപോലെതന്നെ വാര്ത്താമാധ്യമസംഘടനകളും പത്രപ്രവര്ത്തകരും നിയമനിര്മാതാക്കളും നയരൂപീകരണക്കാരും പൊതുസമൂഹവും എല്ലാം ഇതില്പ്പെടും.

ഡീപ്ഫേക്ക് ഭീഷണിപ്രശ്നം ഇന്ത്യ എങ്ങനെ കൈകാര്യം ചെയ്യും?

പോണോഗ്രഫി, രാഷ്ട്രീയപ്രചാരണം, റിവഞ്ച് പോണ്, തീവ്രവാദം, സാമ്പത്തികത്തട്ടിപ്പ് തുടങ്ങിയ മേഖലകളില് ഡീപ് ഫേക്ക് വലിയ രീതിയില് ദുരുപയോഗം ചെയ്യപ്പെടുന്നുണ്ട്. ഡീപ് ഫേക്ക് വീഡിയോകള് സ്ത്രീകള്ക്കെതിരേ വലിയൊരായുധമായി മാറുമെന്നാണ് വിദഗ്ധര് നല്കുന്ന മുന്നറിയിപ്പ്. ഇന്ത്യയില് രാഷ്ട്രീയനേട്ടങ്ങള്ക്കായി എഐ നിര്മിതമായ ഉള്ളടക്കങ്ങള് ഉപയോഗിക്കുന്നതുമായി ബന്ധപ്പെട്ട് ഗവേഷകരും മാധ്യമപ്രവര്ത്തകരും വിവിധ രാജ്യങ്ങളിലെ ഭരണസിരാകേന്ദ്രങ്ങളില് പ്രവര്ത്തിക്കുന്നവരുമായ ആളുകള് ഇതിനകം ആശങ്ക ഉയര്ത്തിയിട്ടുണ്ട്.

ഒരു വ്യക്തിയുടെ സ്വകാര്യത എന്നതിനപ്പുറം ഡീപ്ഫേക്കുകള് എങ്ങനെയൊക്കെയാവും 2024 ല് വരാനുള്ള ഇന്ത്യന് തിരഞ്ഞെടുപ്പിനെ സ്വാധീനിക്കുക എന്നതു വലിയ ചോദ്യമാണ്. ഡിജിറ്റല് മാധ്യമങ്ങളുടെ വരവോടെ ഫേക്ക് ന്യൂസുകളും ഫേക്ക്ചിത്രങ്ങളും തിരഞ്ഞെടുപ്പുകളില് ഇടപെട്ടത് എങ്ങനെയെന്നത് ഇന്നു പഠനവിഷയമാണ്. എതിര്സ്ഥാനാര്ത്ഥിയുടെ ഡീപ് ഫേക്ക് വീഡിയോകള് എത്ര ആഴത്തില് ജനാധിപത്യത്തെ മുറിവേല്പിക്കുമെന്നു നിര്ണയിക്കുന്ന ഒരു തിരഞ്ഞെടുപ്പാവും 2024 ല് വരാനിരിക്കുന്നത്.

ടോണി ചിറ്റിലപ്പിള്ളി

ടോണി ചിറ്റിലപ്പിള്ളി